Qu'est-ce que la conférence de Dartmouth de 1956 et pourquoi marque-t-elle la naissance de l'IA ?

Le Dartmouth Summer Research Project on Artificial Intelligence commence officiellement le 18 juin 1956 et s'achève vers le 17 août, selon les notes manuscrites de Ray Solomonoff, le seul participant à en avoir tenu un journal de bord quotidien. La proposition qui l'a précédé, rédigée le 31 août 1955 par John McCarthy, professeur assistant de mathématiques à Dartmouth, Marvin Minsky, Harvard Junior Fellow en mathématiques et neurologie, Nathaniel Rochester, directeur de la recherche en information à IBM, et Claude Shannon, mathématicien aux Bell Telephone Laboratories, pose une conjecture dont la formulation mérite d'être retenue mot pour mot : « Every aspect of learning or any other feature of intelligence can in principle be so precisely described that a machine can be made to simulate it. ». Traduction directe : tout aspect de l'apprentissage ou toute autre caractéristique de l'intelligence peut en principe être décrit avec suffisamment de précision pour qu'une machine puisse le simuler.

Cette conjecture n'est pas une preuve. Elle est un pari. Un pari audacieux sur la nature calculable de la pensée, formulé à une époque où l'IBM 704 — l'ordinateur à tubes à vide qui servait d'outil principal — remplissait une salle entière. Ce que les quatre organisateurs demandent à la Fondation Rockefeller, c'est du temps et de l'argent pour explorer ce pari collectivement. La Fondation accorde 7 500 dollars sur les 13 500 demandés — un financement jugé modeste, signe d'une certaine hésitation face à ce qu'elle perçoit comme un domaine encore difficile à cerner.

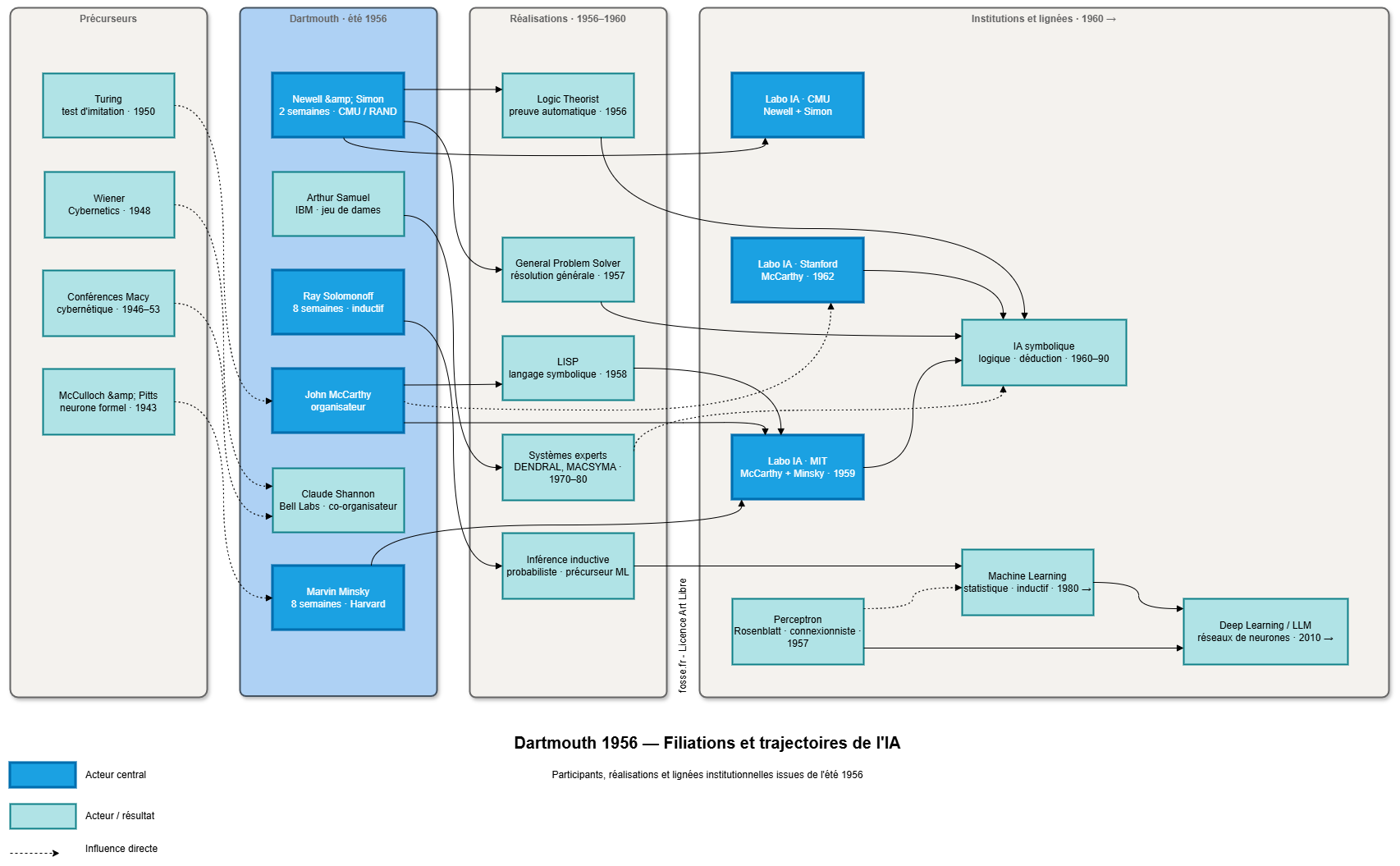

Le projet s'inscrit dans un contexte d'effervescence intellectuelle particulier. Depuis 1943, date de la publication du modèle du neurone formel par Warren McCulloch et Walter Pitts dans le Bulletin of Mathematical Biophysics, des chercheurs de disciplines très différentes tentent de formaliser ce que « penser » pourrait vouloir dire pour une machine. En 1948, Norbert Wiener publie Cybernetics, or Control and Communication in the Animal and the Machine, imposant son propre cadre conceptuel — les boucles de rétroaction, l'analogie entre cerveau et machine — et sa propre autorité. En 1950, Alan Turing propose dans Mind son « jeu d'imitation », qui deviendra le test de Turing. De 1946 à 1953, dix conférences organisées par la Macy Foundation à New York réunissent, sous la présidence de McCulloch, des cybernéticiens, des logiciens et des ingénieurs comme Shannon, von Neumann ou Ashby. Mais ces conférences s'arrêtent en 1953 après une brouille personnelle entre Wiener et McCulloch. Lorsque McCarthy commence à préparer son projet en 1955, le champ est riche d'idées mais fragmenté, sans centre de gravité institutionnel.

Pourquoi John McCarthy a-t-il choisi le nom « artificial intelligence » ?

Le choix du nom est une décision stratégique, assumée. McCarthy le reconnaît lui-même : « l'une des raisons pour inventer le terme artificial intelligence était d'échapper à l'association avec la cybernétique ». Il s'agissait d'éviter d'avoir à accepter Norbert Wiener comme figure tutélaire, et d'écarter une filiation avec les systèmes de rétroaction analogique qui caractérisaient le champ de la cybernétique. Grace Solomonoff, dans ses notes biographiques sur son mari Ray, confirme que McCarthy considérait le mot « cybernétique » comme trop étroitement lié à des approches continues et analogiques, incompatibles avec la logique discrète et symbolique vers laquelle les participants de Dartmouth se tournaient.

Le nom est aussi une rupture avec le titre du livre que McCarthy et Shannon co-éditaient en parallèle, Automata Studies (1956). Pour ce recueil, McCarthy avait voulu un titre plus ambitieux, mais Shannon l'avait convaincu que « automata theory » serait plus sobre et scientifique. McCarthy considérait cette concession comme une erreur. À Dartmouth, il allait la corriger. Le terme artificial intelligence n'est pas nécessairement plus précis que ses concurrents — « complex information processing » selon Newell et Simon, « automata theory », « cybernetics » — mais il est plus ambitieux, plus accrocheur, et surtout il appartient à ceux qui l'ont posé. Comme le note l'historien Thomas Haigh, l'IA est d'emblée une marque autant qu'un programme de recherche : une marque aspirationnelle, nommée d'après un objectif pas encore atteint.

Beaucoup de participants résistèrent au terme. Arthur Samuel trouvait que le mot « artificial » donnait quelque chose de factice à l'ensemble. Newell et Simon refusèrent de l'adopter pendant des années, leur préférant « complex information processing ». Trenchard More, qui nota le plus fidèlement les débats quotidiens, dit n'avoir jamais aimé ni « artificial » ni « intelligence » comme descripteurs du domaine. Rien n'y fit. Le terme s'imposa parce que McCarthy l'avait placé sur l'intitulé officiel du projet.

Qui était présent à Dartmouth et dans quel cadre travaillaient-ils ?

La liste des participants a longtemps été floue. McCarthy avait égaré sa propre liste. Celle reconstituée par Trenchard More et confirmée par les notes de Ray Solomonoff identifie une trentaine de personnes ayant participé à des degrés très divers. Seuls trois chercheurs sont restés les huit semaines complètes : John McCarthy, Marvin Minsky, et Ray Solomonoff. Trenchard More, envoyé par l'université de Rochester en remplacement de Nathaniel Rochester qui était trop absorbé par le travail sur l'IBM 704, participa à trois semaines. Allen Newell et Herbert Simon ne vinrent que les deux premières semaines. Claude Shannon, dont la présence avait été mise en doute, assista bien à la conférence, selon les notes de Solomonoff. John Nash, mathématicien de Princeton qui allait recevoir le Prix Nobel d'économie en 1994, figure parmi les visiteurs occasionnels.

Ils occupaient l'étage supérieur du département de mathématiques de Dartmouth, avec accès libre à une grande salle de cours. Les séances étaient informelles : chaque participant présentait ses idées, les autres réagissaient. Trenchard More se souvient d'une après-midi où le groupe cherchait dans un dictionnaire la définition exacte du mot « heuristic ». Le dictionnaire en question, un gros volume sur son support, était encore là en 2006 lorsque Moor et Heckman, qui organisaient le cinquantenaire AI@50, explorèrent les lieux. Le format ressemble davantage à un atelier de recherche ouvert qu'à une conférence académique. Trois à huit personnes assistant à chaque session, selon les jours et les semaines.

Les egos étaient à la hauteur des ambitions. Minsky lui-même écrivait à McCarthy avant le départ que « d'ici le début du projet, nous aurons tous, je parie, un accord sans précédent sur les questions philosophiques et de langage, de sorte qu'il y aura peu de temps perdu sur de telles trivialités ». C'était un espoir optimiste. Chacun arriva avec ses propres idées et repartit en les ayant développées, sans véritable convergence sur une théorie commune.

Quel est le premier programme d'intelligence artificielle présenté à Dartmouth ?

La nouveauté la plus décisive de l'été 1956 arrive de l'ouest, du RAND Corporation de Santa Monica et de Carnegie Tech à Pittsburgh. Allen Newell, J. C. Shaw et Herbert Simon ont passé les mois précédents à construire un programme capable de prouver des théorèmes de logique propositionnelle tirés du chapitre 2 des Principia Mathematica de Russell et Whitehead. Le Logic Theorist, tel qu'ils le nomment, parvient à démontrer 38 des 52 théorèmes de ce chapitre. Simon dira plus tard, avec sa franchise habituelle : « Au-dessus de Noël, Al Newell et moi avons inventé une machine pensante. »

L'impact immédiat à Dartmouth est, paradoxalement, limité. Newell et Simon arrivent avec les premières sorties papier de leur programme, et Pamela McCorduck rapporte qu'ils les présentent avec fierté et une pointe de défi. Mais la réception est plus tiède qu'enthousiaste. Minsky ne perçoit pas encore, en 1956, que le modèle Newell-Simon est généralisable. Dans une note de décembre de la même année, il mentionne leur travail mais cite ses principales influences comme étant Shannon, Solomonoff et Selfridge. C'est seulement en 1961, dans sa version définitive de « Steps Toward Artificial Intelligence », qu'il reconnaîtra formellement l'apport du Logic Theorist comme méthode générale de raisonnement artificiel.

Le Logic Theorist est codé en IPL (Information Processing Language), un langage de traitement de listes développé par Newell et Shaw. Cette architecture, fondée sur la manipulation de structures de symboles chaînés, préfigure directement le LISP que McCarthy créera en 1958 — un langage dont l'influence sur l'IA symbolique sera considérable pendant trois décennies. L'idée centrale du Logic Theorist — qu'une machine peut raisonner en manipulant des symboles selon des règles de transformation, sans jamais effectuer de calcul numérique — est la rupture paradigmatique que Newell et Simon apportent à Dartmouth. C'est ce qu'Allen Newell appellera plus tard, avec Simon, la « physical symbol system hypothesis » : tout comportement intelligent peut être produit par un système qui manipule des symboles physiques selon des règles.

Quelles tensions intellectuelles sont apparues dès Dartmouth 1956 et structurent encore l'IA aujourd'hui ?

Sous la surface cordiale de l'été 1956, au moins deux fractures profondes se dessinent et ne se refermeront jamais complètement. La première oppose les méthodes symboliques et déductives aux méthodes inductives et probabilistes. Newell et Simon portent la première approche : une machine raisonne en enchaînant des inférences à partir de règles explicites, comme un mathématicien prouve un théorème. Ray Solomonoff représente l'autre pôle : il travaille ce même été sur ce qu'il appelle une « inductive inference machine », un système qui déduit des règles générales à partir d'exemples observés, en utilisant des méthodes probabilistes. Il rédige 175 pages sur le sujet et donne deux exposés devant le groupe. Ses idées sont écoutées avec intérêt mais ne trouvent pas de terrain commun avec celles de Newell et Simon. Cette tension entre logique déductive et apprentissage inductif traverse toute l'histoire de l'IA : elle réapparaît lors de l'AI@50 en 2006, lorsque McCarthy plaide encore pour une IA fondée sur la logique quand David Mumford et Eugene Charniak défendent les méthodes statistiques.

La seconde fracture oppose les systèmes généraux aux systèmes spécialisés. McCarthy veut travailler en profondeur sur un problème unique, comme les jeux d'échecs. Solomonoff insiste pour balayer d'abord un large ensemble de problèmes simples afin d'en extraire des propriétés communes, estimant qu'un excès de focalisation produit des connaissances non transférables. La plupart des participants — Ashby, Samuel, Bernstein, Minsky avec sa machine de géométrie — s'orientent vers des domaines précis et bien délimités. Arthur Samuel travaille sur un programme de jeu de dames qu'il présentera à IBM : l'ancêtre direct des systèmes experts. De cette orientation naît une ligne de développement qui domine les années 1970 et 1980, avec des programmes comme DENDRAL pour la chimie organique ou MACSYMA pour le calcul symbolique. Solomonoff, resté minoritaire à Dartmouth, sera reconnu tardivement comme précurseur de l'apprentissage automatique (machine learning).

Ces fractures se cristallisent aussi dans une question organisationnelle qui ne semble pas fondamentale mais l'est : comment convaincre les financeurs ? Solomonoff note dans ses carnets que Wendy Conquest, réalisatrice d'un documentaire sur l'IA, lui dira plus tard qu'il était perçu comme un tenant des « problèmes faciles » face à des collègues qui préféraient les problèmes difficiles, précisément pour montrer l'efficacité de leurs techniques. Ce « problème de la démonstration au financeur » structure les arbitrages de la recherche en IA depuis 1956 jusqu'aux grands modèles de langage d'aujourd'hui.

Ce que Dartmouth a réellement produit

Le bilan immédiat est maigre, et les participants le disent eux-mêmes. L'évaluation de Solomonoff dans ses carnets est particulièrement laconique : le projet n'a pas été très suggestif, la principale valeur consistant à avoir rencontré des gens intéressants et à avoir compris à quel point la plupart de la pensée dans ce domaine était pauvre. McCarthy résume sa déception d'une formule nette : il mesurait la distance entre ce qu'il avait espéré accomplir et ce qui avait été accompli, et cette distance était grande.

Pourtant, le projet a produit quelque chose que ses participants n'avaient pas tous anticipé : des trajectoires. Minsky retourne au MIT avec des idées précises sur une machine de géométrie, qu'il transmet à Nathaniel Rochester, qui les transmet à Herbert Gelernter. Ce dernier publie en 1959 un programme de preuve de théorèmes de géométrie plane qui devient l'une des pièces majeures de l'IA symbolique des années 1960. Newell et Simon développent le General Problem Solver dès 1957, premier système à tenter une résolution générale de problèmes indépendante du domaine. McCarthy crée le LISP en 1958 et fonde le laboratoire d'IA du MIT avec Minsky en 1959 — la même année qu'il rejoindra Stanford pour y créer son propre laboratoire. La géographie institutionnelle de l'IA pour les trente années suivantes se dessine ici : MIT, Stanford, Carnegie Mellon.

Un point mérite attention du point de vue d'un architecte systèmes. Le projet de Dartmouth ne produit pas une architecture. Il produit un vocabulaire commun et une communauté. Ce que Thomas Haigh appelle une « marque » — le terme artificial intelligence — joue un rôle d'interface entre des chercheurs de cultures différentes (logiciens, ingénieurs, psychologues, neuroscientifiques), entre des institutions (universités, RAND, IBM, Bell Labs), et entre des programmes de financement (NSF, DARPA à partir de 1958). Une marque qui, contrairement aux systèmes experts des années 1980 ou aux approches connexionnistes des années 1990, ne mourra jamais complètement — parce qu'elle est nommée d'après l'objectif, pas d'après la technique.

Le contexte soviétique : une IA parallèle ignorée

Ce que Dartmouth ne dit pas mérite d'être posé. Pendant que McCarthy, Minsky et les autres débattent à Hanover, une recherche parallèle se développe en URSS dans des conditions radicalement différentes. La cybernétique de Wiener avait d'abord été condamnée comme « science bourgeoise » par le régime soviétique au début des années 1950. Mais le recueil Automata Studies de Shannon et McCarthy de 1956 est traduit en russe et diffusé presque immédiatement, contribuant à un changement d'attitude. En 1958, le livre de Wiener est traduit en russe. En 1959, l'Académie des sciences d'URSS crée un Conseil scientifique sur le problème complexe de la « cybernétique », présidé par l'académicien A. I. Berg. Des chercheurs comme Vladimir Yakubovich à Leningrad développent des méthodes d'apprentissage machine, de reconnaissance de formes et de systèmes adaptatifs dont l'originalité ne sera reconnue en Occident que décennies plus tard. La guerre froide a découpé la communauté scientifique en zones étanches.

La même année 1957, Frank Rosenblatt, neurophysiologiste à Cornell, propose son perceptron — un réseau de neurones artificiels formels avec un algorithme d'apprentissage supervisé fondé sur la règle de Hebb. Rosenblatt est lié à la tradition cybernétique que Dartmouth avait délibérément mise à l'écart. En 1969, Minsky et Papert publient Perceptrons, un livre qui démontre formellement les limitations des réseaux monocouches, contribuant à geler le financement de la recherche connexionniste pendant une quinzaine d'années. Ce n'est qu'au milieu des années 1980, avec la redécouverte de la rétropropagation du gradient par Rumelhart, Hinton et Williams, que la ligne d'héritage de Rosenblatt retrouvera sa légitimité — pour culminer, cinquante ans plus tard, dans les transformeurs et les grands modèles de langage.

Ce que soixante-dix ans ont confirmé et infirmé

En 2006, cinq participants originaux de l'été 1956 se retrouvent à Dartmouth pour le cinquantième anniversaire AI@50. McCarthy a soixante-dix-neuf ans. Il maintient sa préférence pour une IA fondée sur la logique. Minsky se plaint que trop d'étudiants se lancent dans l'entrepreneuriat au lieu de chercher leurs propres idées. Solomonoff prédit que des machines vraiment intelligentes ne sont pas si loin, mais que le danger est politique — les technologies disruptives concentrent un pouvoir considérable dans les mains de quelques individus et gouvernements. Cette dernière remarque, tenue dans une salle de conférence universitaire en 2006, est d'une actualité troublante vingt ans plus tard.

La conjecture fondatrice de 1955 — que tout aspect de l'intelligence peut être suffisamment décrit pour être simulé — n'a pas été réfutée. Elle n'a pas non plus été confirmée dans le sens que ses auteurs imaginaient. L'IA symbolique des années 1960-1990 a produit des systèmes remarquables dans des domaines contraints, puis s'est heurtée au mur de la représentation des connaissances du sens commun. L'apprentissage profond des années 2010, fondé sur la statistique et les réseaux de neurones — l'approche que Dartmouth avait marginalisée — a produit des systèmes capables de performances surprenantes dans des tâches perceptuelles et linguistiques, sans pour autant résoudre le problème du raisonnement général que Newell et Simon poursuivaient.

Ce que Dartmouth a vraiment fondé, ce n'est pas une solution. C'est un programme de recherche ouvert, organisé autour d'une question qui résiste : qu'est-ce que penser, et dans quelle mesure peut-on le décrire avec suffisamment de précision pour l'implémenter ? Soixante-dix ans et plusieurs révolutions technologiques plus tard, la question reste entière. Ce qui a changé, c'est l'échelle des moyens engagés pour y répondre — et les enjeux de souveraineté, de contrôle et de concentration de pouvoir que cette réponse partielle a déjà engendrés.

Conclusion

L'été 1956 à Dartmouth n'est pas le moment où une machine a appris à penser. C'est le moment où un groupe de chercheurs a décidé que ce problème méritait un nom propre, une communauté propre, et un programme de recherche distinct. Cette décision éditoriale et institutionnelle a eu plus d'effets à long terme que les résultats scientifiques immédiats de ces dix semaines. Le Logic Theorist de Newell et Simon, ignoré dans sa portée paradigmatique par la plupart des présents, a planté la graine du traitement symbolique de la connaissance. Les tensions entre logique et probabilités, entre systèmes généraux et spécialisés, ont tracé des frontières de débat qui traversent encore aujourd'hui les laboratoires et les conseils d'administration. Et la « marque » IA, posée sur l'objectif plutôt que sur la technique, a survécu à toutes les révolutions de méthode — une promesse perpétuellement renouvelée, jamais tout à fait tenue, jamais tout à fait abandonnée.